Google ha annunciato il 12 maggio 2026, durante l’evento online The Android Show, la nuova piattaforma Gemini Intelligence. L’idea è portare su Android funzioni di intelligenza artificiale più personali e più presenti nella vita di tutti i giorni.

Una mossa che arriva a poche settimane dalla WWDC 2026 di Apple, in programma l’8 giugno, e che guarda chiaramente alla sfida con Siri e Apple Intelligence. Il momento, del resto, è delicato: Google promette il debutto già dall’estate, mentre Apple deve ancora completare alcune funzioni annunciate nel 2024, compresa una versione più utile e “personale” del suo assistente vocale.

Google accelera su Gemini: prima Pixel, poi Samsung Galaxy

La nuova suite Gemini Intelligence mette insieme diverse funzioni pensate per rendere lo smartphone meno passivo. Non solo risposte, ma azioni. Google l’ha mostrata soprattutto sui telefoni Pixel, dove può controllare più da vicino sia il software sia l’hardware, ma ha confermato che le prime novità arriveranno anche sui Samsung Galaxy più recenti. Per gli altri marchi Android, da Motorola ai produttori più piccoli, i tempi restano invece vaghi. “Il rilascio inizierà questa estate”, ha spiegato l’azienda durante la presentazione, senza però indicare date precise modello per modello.

Tra le novità più concrete c’è Gemini in Chrome, pensato per riassumere pagine web, mettere a confronto informazioni prese da fonti diverse e aiutare nelle attività più ripetitive, come prenotazioni o moduli da compilare. Android dovrebbe poi usare la cosiddetta Personal Intelligence per inserire in automatico dati nei campi di testo: una compilazione automatica, ma spinta dall’IA. Più curiosa è Rambler, integrata nella tastiera Gboard. L’utente parla in modo naturale, anche con frasi confuse o interrotte, e il sistema trasforma quel flusso in un messaggio ordinato, togliendo esitazioni, ripetizioni e giri a vuoto. Sulla carta è una funzione semplice. Ma molto vicina all’uso di tutti i giorni.

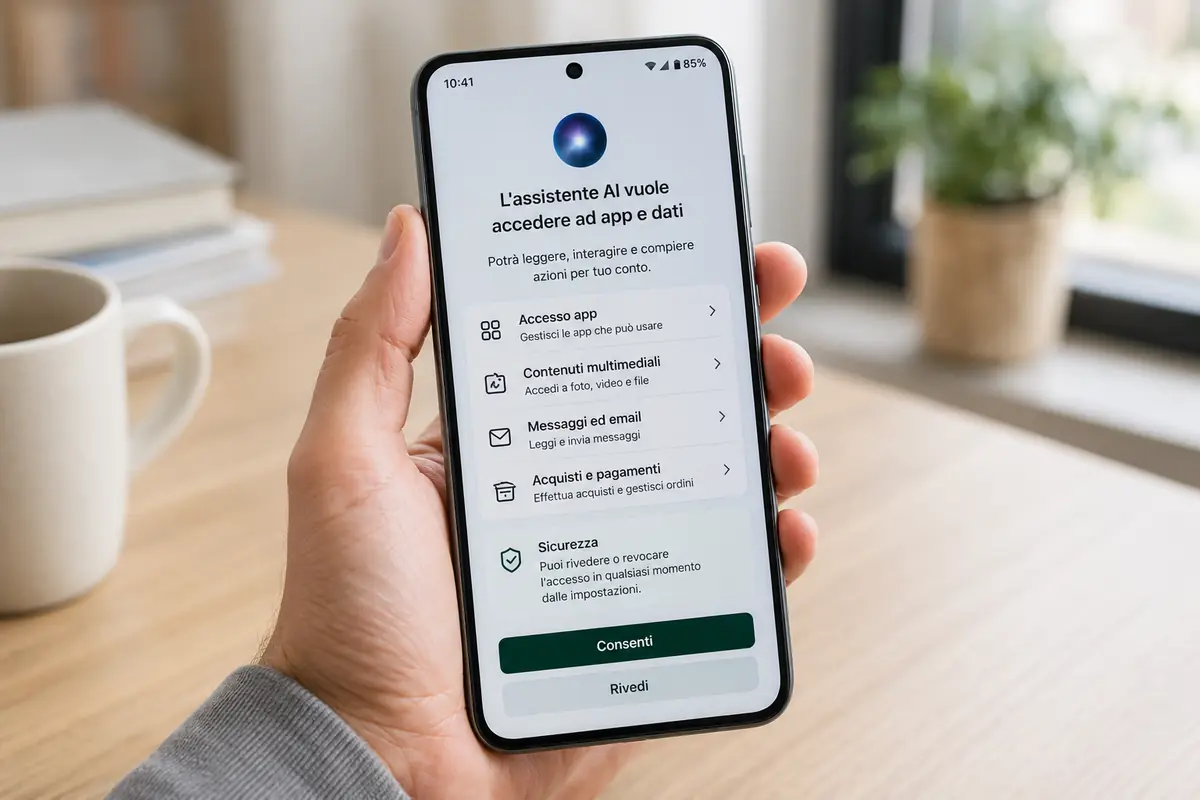

Google ha mostrato anche Create My Widget, che permette di creare widget personalizzati partendo da una richiesta scritta in linguaggio naturale: per esempio solo vento e pioggia, invece delle previsioni complete, oppure una lista settimanale di idee per la cena. La funzione più ambiziosa, però, resta l’automazione multi-app. Gemini dovrebbe poter prenotare una lezione in palestra, organizzare un viaggio su Expedia o trasformare una lista della spesa aperta in un’app di note in un carrello online. Ed è qui che si entra nel terreno più scivoloso: le demo sul palco riescono quasi sempre, la vita reale è un’altra cosa.

Apple Intelligence all’esame della WWDC

L’annuncio di Gemini Intelligence arriva meno di un mese prima della WWDC 2026, dove Apple presenterà le prossime versioni dei suoi sistemi operativi e, con ogni probabilità, nuove funzioni di Apple Intelligence. La tempistica non passa inosservata. Google da anni organizza i suoi eventi prima della conferenza per sviluppatori di Cupertino, ma questa volta l’effetto è chiaro: entrare nel dibattito su Siri, ancora in attesa del salto promesso nel 2024. Apple aveva parlato di un assistente più personale, capace di capire il quadro della situazione, leggere ciò che compare sullo schermo e muoversi tra le app. Quel pacchetto, però, non è ancora arrivato in forma completa.

Il passato invita alla prudenza, per tutti. Google ci ha già provato con funzioni di assistenza proattiva: Google Now, lanciato nel 2012 e poi sostituito da Google Assistant, e Google Duplex, presentato nel 2018 per fare telefonate al posto dell’utente, ma ridimensionato negli anni successivi anche per problemi tecnici, legali e di privacy. Alcune idee sono rimaste, come Hold for Me e Call Screen sui Pixel, usate per gestire le attese al telefono e filtrare le chiamate. Altre sono scomparse. È lo stesso nodo che riguarda Apple: non basta annunciare un’IA capace di fare tutto. Bisogna dimostrare che serva davvero, ogni giorno, quando l’effetto novità è finito.