Purtroppo, una pericolosa estensione di Google Chrome sembra capace di leggere le conversazioni di ChatGPT.

L’ipotesi di introdurre forme di pubblicità all’interno di ChatGPT apre una nuova fase per l’utilizzo quotidiano dell’intelligenza artificiale, ma porta con sé anche criticità legate alla sicurezza. In questo contesto, stanno emergendo segnali concreti di come alcune modifiche all’ecosistema possano essere sfruttate da soggetti malevoli, con l’obiettivo di intercettare dati sensibili degli utenti.

Secondo quanto rilevato da diversi analisti di sicurezza, la crescente attenzione verso eventuali inserzioni pubblicitarie ha creato uno spazio fertile per operazioni fraudolente che si presentano come strumenti utili, ma nascondono funzionalità invasive.

L’estensione “ChatGPT Ad Blocker”: come funziona il meccanismo di raccolta dati

Tra i casi più rilevanti compare un’estensione per Google Chrome denominata “ChatGPT Ad Blocker”, presentata come un semplice blocco annunci. In realtà, il software opera in modo completamente diverso rispetto a quanto dichiarato.

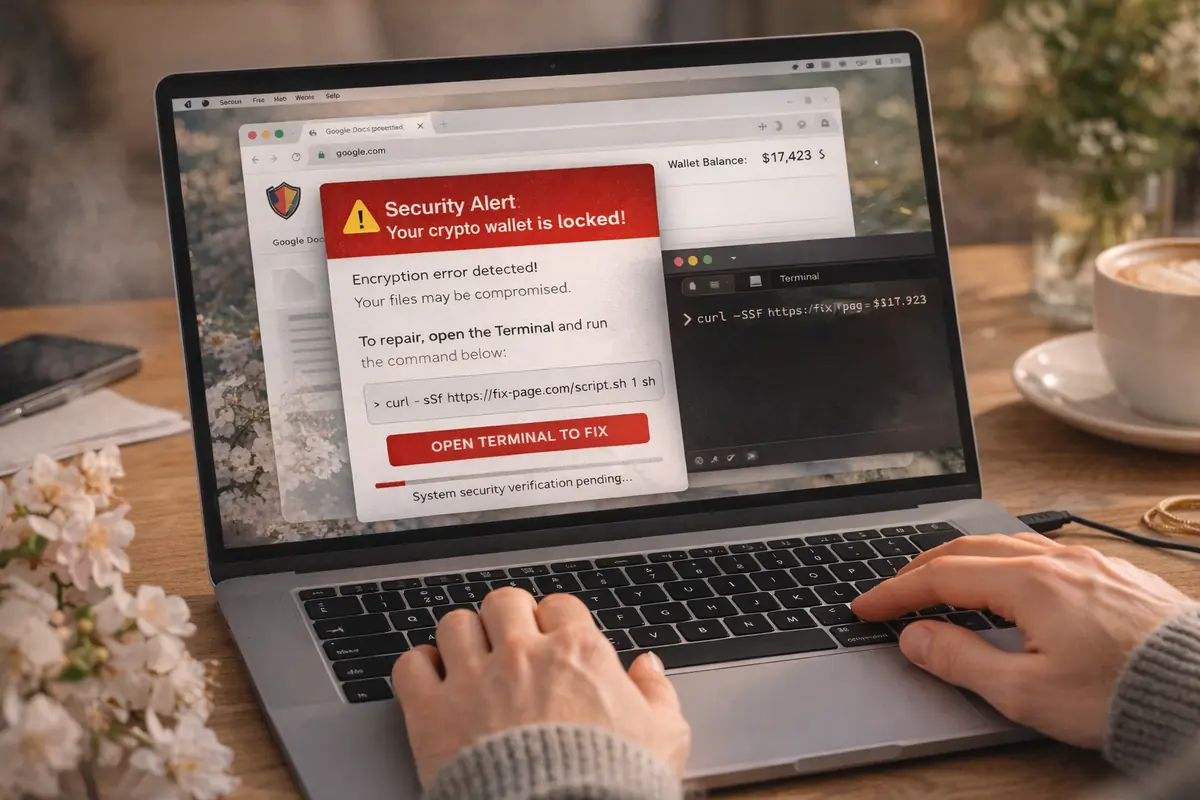

In cosa consiste l’allarme riguardante Google Chrome (www.melablog.it)

L’estensione, una volta installata, accede alla pagina attiva di ChatGPT e copia l’intera struttura HTML della conversazione, includendo input dell’utente, risposte generate e metadati associati. Queste informazioni vengono poi trasmesse a un server esterno, identificato in un canale privato sulla piattaforma Discord, gestito tramite un bot denominato “Captain Hook”.

Il meccanismo è particolarmente critico perché consente la raccolta sistematica di contenuti testuali completi, senza che l’utente abbia una percezione immediata dell’attività in corso.

Il ruolo degli analisti e il riferimento a DomainTools

Gli esperti di sicurezza hanno identificato con precisione la finalità dell’estensione, sottolineando come l’obiettivo principale sia la raccolta strutturata dei dati. Le analisi evidenziano che il software non si limita a intercettare singole informazioni, ma acquisisce l’intero flusso delle conversazioni.

Questo approccio consente ai soggetti responsabili di ottenere una quantità significativa di dati, potenzialmente utilizzabili per attività di profilazione, rivendita o ulteriori attacchi informatici. La presenza di un’infrastruttura automatizzata per la trasmissione dei dati indica un’operazione progettata per funzionare su larga scala.

Un fenomeno già osservato: precedenti utilizzi impropri dell’AI

L’utilizzo improprio di strumenti basati su intelligenza artificiale non rappresenta un caso isolato. Negli ultimi anni sono stati documentati episodi in cui contenuti generati artificialmente sono stati utilizzati per manipolare risultati di ricerca o diffondere informazioni ingannevoli.

Nel caso specifico di ChatGPT, il valore dei dati trattati — spesso legati a richieste personali, professionali o aziendali — rende la piattaforma un obiettivo particolarmente interessante per chi opera nel settore del cybercrime.

Il caso dell’estensione “ChatGPT Ad Blocker” evidenzia un aspetto spesso sottovalutato: il livello di accesso concesso alle estensioni del browser. Molti di questi strumenti richiedono autorizzazioni estese, che includono la possibilità di leggere e modificare i contenuti delle pagine visitate.

Questa capacità, se utilizzata in modo improprio, permette di intercettare informazioni sensibili senza necessità di violare direttamente i sistemi della piattaforma. Il rischio non riguarda quindi solo il servizio principale, ma anche l’ecosistema di strumenti che vi si collegano.

Sicurezza e prevenzione: comportamenti da adottare

In un contesto in cui l’utilizzo dell’intelligenza artificiale è sempre più diffuso, la gestione dei dati diventa un elemento centrale. Anche in presenza di software di protezione, come antivirus o sistemi anti-malware, il primo livello di sicurezza resta legato al comportamento dell’utente.

È essenziale verificare con attenzione le autorizzazioni richieste dalle estensioni, controllare la provenienza dei software installati e limitare la condivisione di informazioni sensibili all’interno delle conversazioni. La natura stessa delle piattaforme di AI, basata sull’elaborazione di input testuali, rende ogni dato inserito potenzialmente esposto a rischi in caso di strumenti compromessi.

L’introduzione di nuove funzionalità, come la pubblicità, rappresenta un passaggio naturale nell’evoluzione delle piattaforme digitali, ma comporta anche un aumento della superficie di attacco. Il caso dell’estensione fraudolenta dimostra come ogni cambiamento possa essere rapidamente sfruttato da attori esterni.

Per gli utenti, la sfida è mantenere un utilizzo consapevole degli strumenti digitali, valutando non solo le funzionalità offerte ma anche le implicazioni in termini di sicurezza e privacy. In un ecosistema in continua evoluzione, la protezione dei dati passa sempre più da una combinazione di tecnologia e attenzione individuale.